La banalità di ChatGPT: ecco come gli utenti usano il programma di intelligenza artificiale più diffuso al mondo

Ricette, guide pratiche, aiuto nella scrittura di messaggi ed e-mail e persino supporto emotivo. Oltre un milione di utenti mostra ogni settimana attaccamento al chatbot o potenziali intenti suicidi. Quasi tre adolescenti italiani su quattro lo usano almeno qualche volta a settimana. Più della metà per chiedere “consigli importanti”

Consigli su come riparare il lavandino, scrivere una mail di lavoro o creare un’app. Ma anche un medico a cui rivolgersi per un parere o un amico a cui chiedere aiuto. Nel giro di pochi anni il fenomeno dei chatbot è esploso: centinaia di milioni di persone ormai si affidano ad applicazioni basate su modelli di intelligenza artificiale per trovare soluzioni ai problemi più disparati, fino a sostituire le ricerche web e, in alcuni casi, lo psicologo.

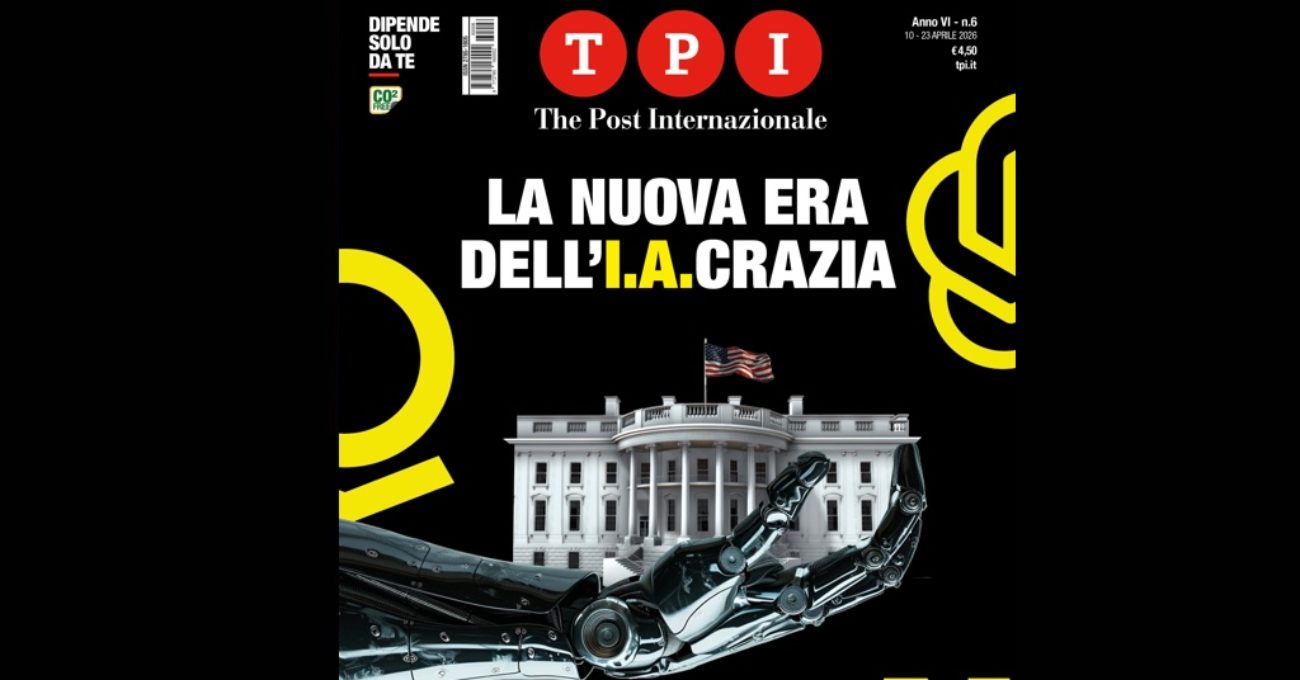

Questa crescita esponenziale ha posto i modelli linguistici di grandi dimensioni, su cui sono basati chatbot come ChatGPT, al centro di una concorrenza serrata tra i colossi del tech statunitense. Una corsa alimentata da valutazioni record, ma anche dalla necessità, per Washington, di difendere il vantaggio nel settore dell’intelligenza artificiale dalla concorrenza di Pechino.

Mentre gli analisti dibattono sulla sostenibilità dell’ondata di investimenti che si è riversata sul settore, e sugli effettivi benefici economici dei programmi intelligenti, molti esperti stanno rivolgendo la loro attenzione verso i cambiamenti che questi strumenti stanno già causando all’interno di famiglie, scuole e uffici. Mettendo in evidenza come l’intelligenza artificiale potrebbe mettere a rischio lavori un tempo considerati sicuri o rendere superflui metodi didattici consolidati. Ma anche causare danni “collaterali” alla psiche degli utenti stessi.

Un tema salito alla ribalta negli scorsi mesi con una serie di cause intentate contro OpenAI, che hanno gettato più di qualche ombra sul funzionamento di ChatGPT e sulle ricadute delle interazioni con il chatbot sulla salute mentale degli utenti più fragili.

Assecondare gli utenti?

L’accusa all’organizzazione guidata da Sam Altman è quella di aver dato eccessiva priorità alle interazioni, a costo di assecondare ogni richiesta degli utenti. Fino a innescare una spirale che ha portato alcuni utenti a instaurare una relazione con un interlocutore programmato per compiacerli, anche nelle richieste più estreme. Al punto che diverse famiglie hanno accusato OpenAI di aver assistito i propri figli nel tentativo di togliersi la vita.

Le segnalazioni di comportamenti anomali sono aumentate improvvisamente dopo lo scorso aprile, quando OpenAI ha rilasciato una nuova versione di ChatGPT che, come ammesso dalla stessa organizzazione, era eccessivamente «ruffiana» (“sycophantic”). Secondo OpenAI questo nuovo modello, chiamato ChatGPT-4o, «mirava a compiacere» gli utenti, «legittimando» i loro «dubbi», «fomentando la rabbia», «invitando a compiere azioni impulsive» e «rafforzando le emozioni negative in modi non previsti».

Come nel caso di un uomo di New York, raccontato dal quotidiano statunitense New York Times, che si era convinto di essere “Neo”, il protagonista di Matrix, ed era stato rassicurato da ChatGPT che avrebbe potuto spiccare il volo se si fosse lanciato da un grattacielo, a patto che ci credesse «pienamente»; o quello di una donna del Maine, convinta di parlare, tramite ChatGPT, con spiriti extra-dimensionali. Più di recente è emerso che tra gli utenti a rischio, negli scorsi mesi, c’era anche l’autrice della strage di Tumbler Ridge, in Canada, in cui la 18enne transgender Jesse Van Rootselaar ha ucciso otto persone prima di togliersi la vita. Secondo quanto riportato dal quotidiano statunitense Wall Street Journal, Van Rootselaar aveva descritto a ChatGPT scenari di violenza con armi da fuoco durante conversazioni che si erano svolte nell’arco di diversi giorni, allarmando diversi impiegati di OpenAI, alcuni dei quali avevano chiesto ai dirigenti di allertare le autorità canadesi. Alla fine la decisione è stata solo di bloccare l’account di Van Rootselaar.

OpenAI e il suo amministratore delegato Sam Altman hanno ammesso che gli aggiornamenti incriminati avevano reso il chatbot «troppo ruffiano e fastidioso», pur sostenendo che la percentuale di persone che hanno instaurato «relazioni parasociali» con ChatGPT è «molto piccola». Ad agosto l’organizzazione è tornata sui suoi passi, con un nuovo modello, chiamato GPT-5, che prometteva di assecondare meno gli utenti, sostenendo negli aggiornamenti successivi di aver predisposto meccanismi per identificare i più a rischio.

A settembre il caso è sfociato in un’inchiesta della Federal Trade Commission sui potenziali danni causati dai chatbot che si comportano come “compagni” degli utenti. L’agenzia ha anche ordinato a sette aziende, tra cui OpenAI, Meta e Alphabet, di fornire informazioni su come i loro prodotti «monetizzano» le interazioni, elaborano le richieste degli utenti e limitano gli effetti negativi, in particolare su bambini e adolescenti.

Com’è usato il chatbot

Capire effettivamente come vengono utilizzati i chatbot e i rischi che pongono realmente per gli utenti, può non essere semplice. L’utilizzo che si fa di questi strumenti non è infatti pubblico, come avviene per i social, offrendo poche possibilità a chi è esterno all’azienda di analizzare il comportamento degli utenti o il tipo di risposte che il chatbot fornisce loro.

Recentemente uno studio della stessa OpenAI ha cercato di dare qualche risposta a chi si interroga su come sta evolvendo l’utilizzo di ChatGPT, arrivata a contare più di 800 milioni di utenti a settimana.

Basato sulle chat di 1,5 milioni di persone con il chatbot, risalenti al periodo tra maggio 2024 e giugno 2025, lo studio ha scoperto che gli utenti sono composti prevalentemente da donne e giovani: quasi la metà delle conversazioni analizzate proviene infatti da persone di età compresa tra i 18 e i 25 anni.

La ricerca, realizzata dal team di OpenAI che si occupa di “ricerca economica” e dall’economista di Harvard David Deming, sostiene inoltre che il ChatGPT si stia diffondendo più rapidamente nei Paesi più poveri che in quelli più ricchi.

Usi lavorativi o personali?

Per quanto riguarda l’utilizzo che si fa di ChatGPT, quello che emerge è che non è concentrato al solo ambito lavorativo. A giugno 2024, le richieste al chatbot erano suddivise in modo pressoché uniforme tra uso lavorativo e personale. Dopo un anno, secondo lo studio, gli usi non lavorativi rappresentavano il 73 per cento di tutte le conversazioni. Sempre più utenti non si limitano infatti a usare il chatbot per preparare presentazioni o mail, ma finiscono per interrogare l’intelligenza artificiale per chiedere consulenze mediche, legali o come semplice passatempo, facendo entrare questi strumenti sempre più nelle proprie vite.

La principale categoria di utilizzo, tra le sette totali indicate nello studio, è quella dei “consigli pratici”, come i consigli per il fai da te e per allenarsi, in cui ricade il 28,3 per cento di tutte le chat analizzate. Segue poi, al 28,1 per cento, la “scrittura” in cui rientra la scrittura di e-mail o di post per i social. Secondo OpenAI le richieste più popolari in questo ambito sono quelle relative alla «modifica o la critica» di un testo, seguite da quelle per la «scrittura personale o la comunicazione». Solo al terzo posto quelle per la traduzione, seguite dalle richieste per la «generazione di argomentazioni o riassunti» e la scrittura di racconti.

Un “sostituto” perfetto

Uno dei dati più interessanti è quello relativo alla domanda di informazioni, che comprende il 21,3 per cento delle richieste. Una categoria in forte crescita che, secondo i ricercatori «sembra essere un sostituto» quasi perfetto «della ricerca sul web». Un indice della minaccia che OpenAI potrebbe rappresentare per un colosso delle ricerche come Google. Il 2,1 per cento di tutte le chat in questa categoria era relativa a richieste su “prodotti acquistabili”, una potenziale miniera d’oro per OpenAI nel caso decidesse di fare leva sulle pubblicità.

Solo Il 4,2 per cento delle conversazioni contiene invece richieste che riguardano la programmazione, uno degli ambiti che più si prepara a essere rivoluzionato dall’intelligenza artificiale.

C’è anche chi utilizza ChatGPT per chiedere consiglio su questioni sentimentali e «riflessioni personali» (l’1,9 per cento delle conversazioni) e chi, come nei casi descritti in precedenza, prende parte a «giochi di ruolo» con il chatbot. Questa categoria, che comprende lo 0,4 per cento dei casi, comprende anche le conversazioni in cui gli utenti trattano il chatbot come una «fidanzata» artificiale.

Questi dati indicherebbero, secondo i ricercatori, che la percentuale di messaggi relativi a rapporti di «compagnia» con il chatbot o a «problemi socio-emotivi» è «piuttosto piccola». Ma in termini assoluti i numeri potrebbero non essere così trascurabili.

Per quanto riguarda i casi più estremi, OpenAI ha dichiarato che lo 0,15 percento dei propri utenti ogni settimana «indicano livelli potenzialmente elevati di attaccamento emotivo a ChatGPT» e che lo stesso dato vale anche per gli utenti che «hanno conversazioni che includono indicatori espliciti di potenziale pianificazione o intento suicida». Una percentuale apparentemente bassa ma che, come osserva i quotidiano statunitense l Washington Post, si traduce in più di un milione di persone a settimana.

Clienti giovanissimi

In Italia un’indagine promossa da Save The Children, in collaborazione con CSA Research, ha cercato di approfondire l’uso che stanno facendo di questa nuova tecnologia gli adolescenti, di gran lunga i più entusiasti nell’adottare i chatbot.

Lo studio sembra rilevare una spaccatura a livello generazionale. A partire dalla frequenza di utilizzo, con il 74,2 per cento degli adolescenti italiani che dice di utilizzare i chatbot almeno qualche volta a settimana, rispetto al solo 25,2 per cento degli adulti.

Ma sembra diversa soprattutto la percezione di questi strumenti da parte degli adolescenti, che al 58,1 per cento dicono di aver chiesto consigli a strumenti di intelligenza artificiale «su qualcosa di serio e di importante» per la propria vita (il 14,3 per cento spesso, il 43,8 per cento qualche volta).

Il 32,6 per cento degli adolescenti intervistati ha infatti dichiarato che, se l’intelligenza artificiale fosse una persona, la indicherebbe come «un esperto» mentre, alla stessa domanda, gli adulti hanno risposto prevalentemente «un collaboratore» (28,5 per cento della popolazione). Altre definizioni scelte dagli adolescenti sono quelle di «caro amico (al 13 per cento, rispetto al 3,5 per cento degli adulti), di «fratello maggiore» (8,9 per cento) e anche di «psicologo», risposta data dall’8,8 per cento degli adolescenti e dall’1,4 per cento degli adulti. Solo il 5,8 per cento degli adolescenti, rispetto al 23,1 per cento degli adulti, vede invece l’intelligenza artificiale come «un estraneo».